Hallo,

hat’s hier jemanden mit praktischen Erfahrungen (oder auch Interesse) im Bereich 3D-Scannen mit Kamera und Laserlinie oder “Licht-Mustern”?

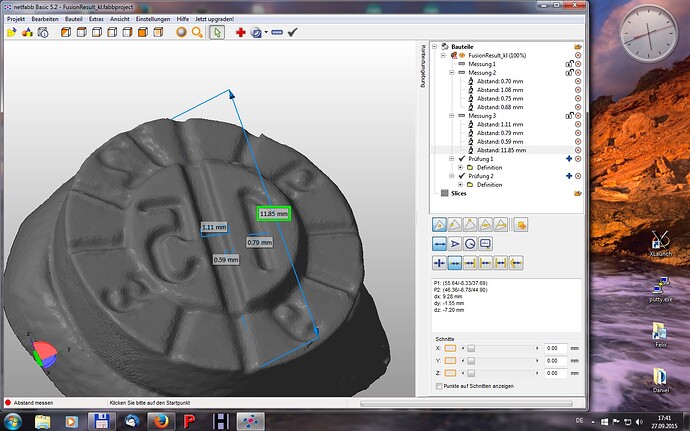

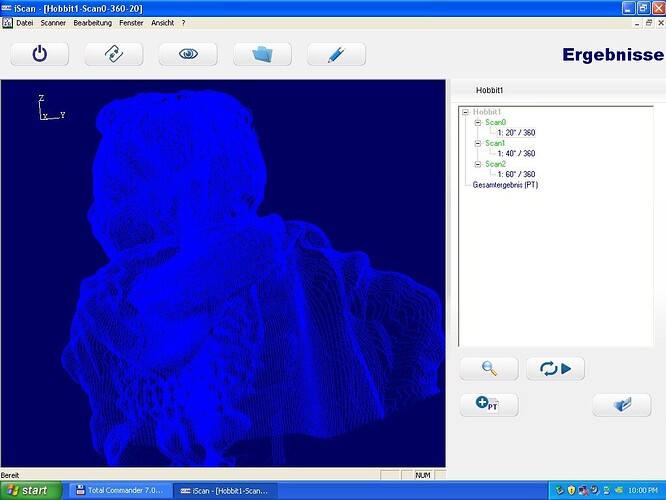

Ich denke an sowas wie den DavidLaserscanner,den ich ganz zu Beginn noch mit einem Linienlaser verwendet hatte und später mit den auf “Muster-Projektor” umgebauten Casio-DLP-Beamern.

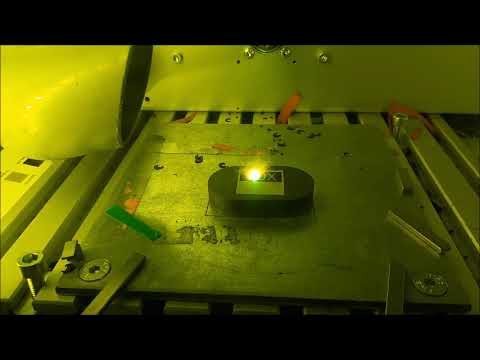

Konkret geht es mir um eine Kombination von Galvo-Lasern mit einer Kamera neben dem Galvokopf.

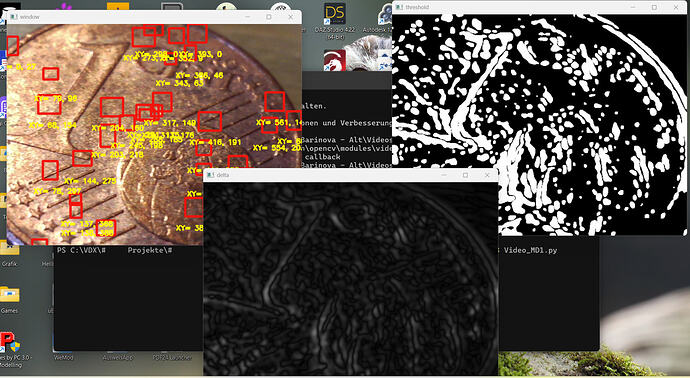

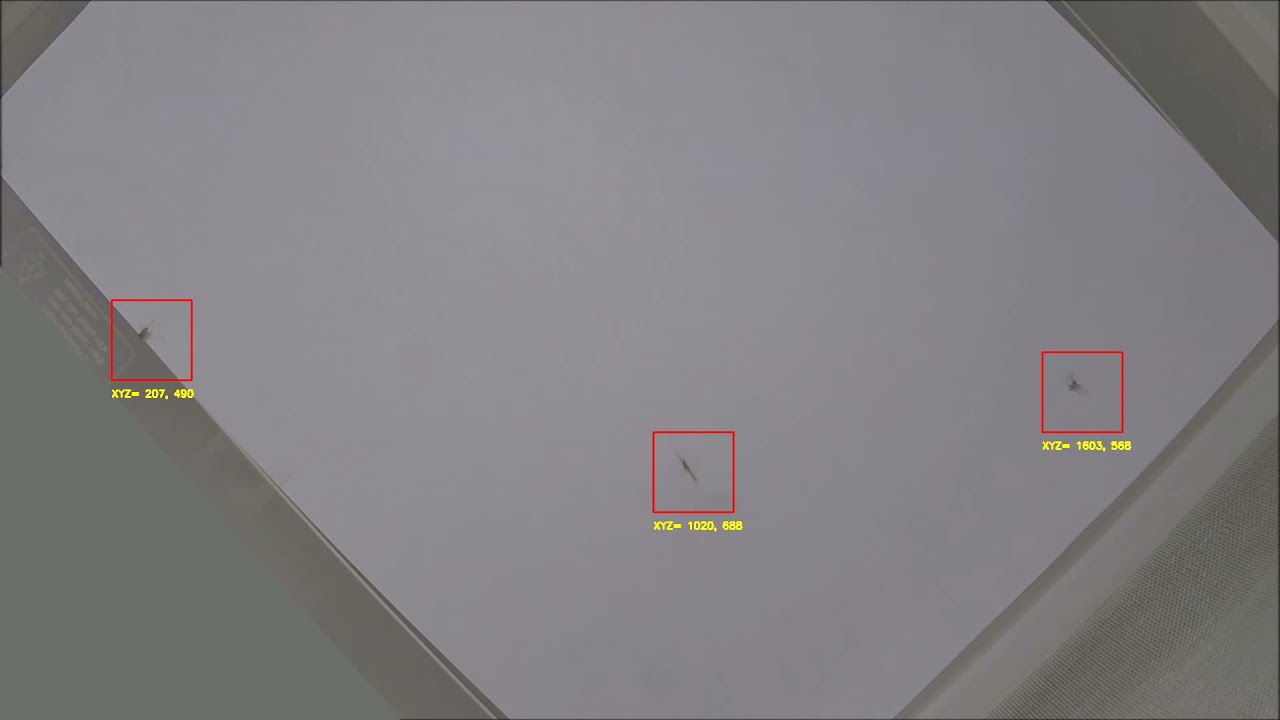

Der Galvo kann enorm schnell jeden Punkt der Oberfläche beleuchten … und eine Kamera entsprechend den Versatz für die Triangulationsberechnung aufnehmen.

Neben den “normalen” Galvos aus der Materialbearbeitung (und auch ein paar aus dem Lasershow-Bereich) habe ich auch einen telezentrischen “Mikro”-Galvo mit 6x6mm Scanbereich und einer Laserspot-Größe von unter 10µm, was sich für eher kleine Objekte mit 3D-Detail-Auflösung von unter 10µm eignen würde … mit einem XY(Z) Positionierer unter dem Galvo lassen sich dann auch mit der “6x6mm-Optik” größere Flächen und Objekte abscannen.

Wenn schon jemand was in der Richtung macht oder hat, oder Interesse an einem Entwicklungsprojekt in der Richtung, könnte man sich ja etwas austauschen ![]()